バラ積みピッキングにおける機械学習(ML)の価値は、認識の頑健性と、導入後に失敗事例から学習して継続的に改善を回せる運用性にあります。

本稿では、次の順で整理します。

- ルールベース手法が現場でつまずく理由

- MLビジョンで何が変わるか

- 立ち上げと改善をどう回すか

- モデル以外に必要な実装要素

- ベンダー選定で確認すべき点

なお、本記事では次の用語が登場します。

機械学習関連

- 機械学習(ML):データからパターンを学習し、推定や判断に使う手法の総称

- ニューラルネットワーク:MLで広く用いられるモデル構造

- 深層学習(ディープラーニング):多層のニューラルネットワークで特徴を学習する手法(本稿の認識タスクでは主にこれを利用)

- 強化学習:試行錯誤を通じて行動方策を最適化するML手法(把持戦略・動作最適化の研究で検討される)

応用とアプリケーション関連

- AIビジョン:検出・姿勢推定など認識機能の技術レイヤ

- AIバラ積みピッキング:AIビジョンを含む把持〜搬送の実用アプリケーション

- フィジカルAI:認識・計画・制御を含む実世界動作全体の上位概念

バラ積みピッキングが解くべき2つの問題

バラ積みピッキングシステムには、大きく2つの役割があります。

① ビジョン(認識)

部品の位置や姿勢を認識し、ロボットがどこを掴むべきか判断する。

② モーション(動作)

ロボットが部品へ移動し、ピックして、目的の場所へ配置する。

機械学習は理論上どちらにも使えますが、実際にはビジョン側で大きな効果を発揮します。

モーション計画については従来手法が長年発展しており、すでに安定した性能を持っています。

そのため、モーションに機械学習を適用すると、複雑さだけが増えるケースも少なくありません。

従来のルールベースビジョンの限界

従来のルールベース画像処理では、エッジ・輪郭・寸法条件などを人手で設計して認識します。

この方式は設計時の前提が合っている間は有効ですが、現場では次の変動に弱い傾向があります。

- 照明条件の変化

- 表面仕上げや反射特性の差

- 微小な形状差や重なり方の違い

さらに、あるケースを改善するためのルール調整が、別のケースの不安定化を招くことがあります。この保守負債が、ルールベース手法の運用を難しくする主因です。

MLビジョンが効く理由

MLビジョンは、ルールベース手法とは問題へのアプローチが根本的に異なります。

ルールベースではエンジニアが「部品の見え方」を定義するのに対し、MLでは部品の特徴をデータから学習します。

明示ルールではなく画像パターンの統計的特徴を学習するため、実装では深層学習ベースのニューラルネットワークが広く使われ、現場で起きるばらつきに対して相対的に頑健です。

基本フローは次の通りです。

1. 画像収集(実機またはシミュレーション)

2. ラベル生成(位置・姿勢・把持可否)

3. 学習(事前学習モデルの転移学習を含む)

4. 評価(成功率・誤検出・推論遅延)

5. 現場再学習(失敗データの追加)

実案件では、ルールベース手法より高い成功率が得られるケースが多く、導入後の改善速度も確保しやすくなります。

目安としては、MLビジョンで98~99.9%、ルールベースでは複雑部品で約70%で頭打ちになる事例もあります(いずれも案件条件により変動)。

なお、MLにも適さない用途があります。精密寸法測定では、MLで部品の位置・姿勢を認識し、ルールベースで寸法を測定する併用構成が最適です。

現場立ち上げの実際

「新規部品には数千枚の画像が必要」と思われがちですが、量産立ち上げでは実務上現実的ではありません。

現在は、事前学習済みの基盤モデルを活用した転移学習が一般的です。

多くのケースでは、20〜30枚程度の追加画像で初期立ち上げが可能です。

一方で、姿勢ばらつきが極めて大きいランダムビンピッキングでは難易度が上がります。

この高難度条件では、3Dモデルを使った3Dマッチングベースの学習が有効です。

- 数万通りの位置・姿勢をシミュレーション

- 合成学習画像を自動生成

- CADデータがあれば活用、なければ実物から3Dモデルを作成

導入後に性能を伸ばす運用

ML導入の真価は、導入後の改善サイクルにあります。

失敗事例を学習データに追加し、短時間で再学習・再評価を回すことで、性能を継続的に向上できます。

さらに、モデル改善やデータ更新を定期アップデートとして適用すれば、処理速度の向上や失敗率の低減が期待できます。

失敗原因の切り分け(認識 vs 実行)

ピック失敗は、必ずしも認識が原因ではありません。

原因は大きく2系統です。

1. 認識起因:MLが不適切なピック位置を提案

2. 実行起因:提案は妥当だがロボット側で実行失敗

実行起因の代表例:

- キャリブレーション誤差

- 吸着パッドの密着不良

提案ピック位置をデジタルツイン上に重ねて確認すると、再学習すべきか機械調整すべきかを短時間で切り分けられます。

なお、バラ積みピッキングの認識では深層学習が中心ですが、把持戦略や動作最適化の研究領域では強化学習が検討されることもあります。

モデル単体では実用化できない

研究環境で高い性能を示すモデルでも、工場の要件(安定性・保守性・運用性)を満たせず実用化に至らないケースが少なくありません。

モデルは重要ですが、研究成果を実際の生産システムにするには、多くの要素が不可欠です。

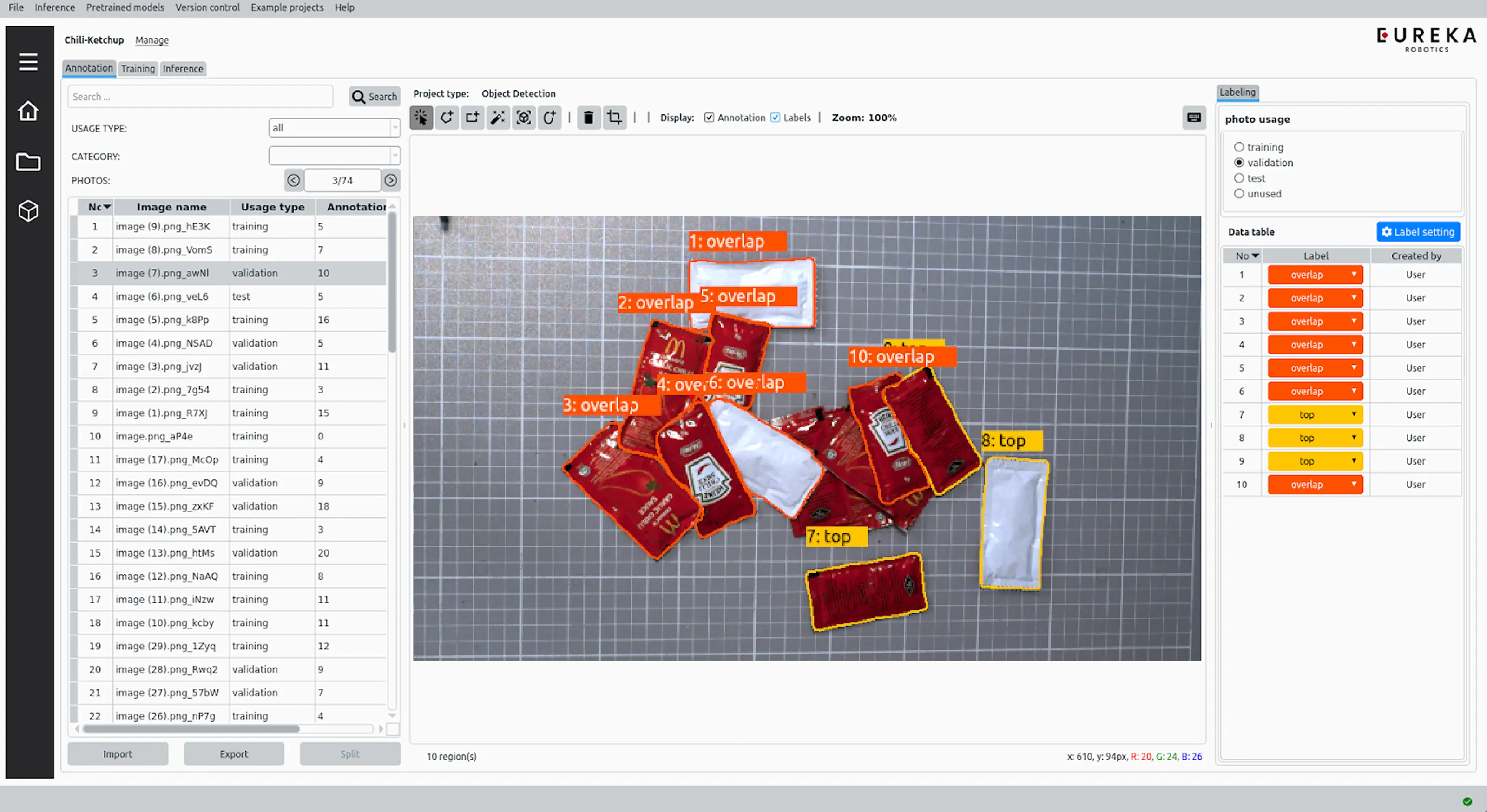

- ユーザーインターフェース:専門知識のないユーザーでも、画像収集・部品アノテーション・モデル学習といった作業ができる仕組み

- データ管理パイプライン:アクセス制御・版管理を含め、大量データを扱いながら顧客の部品データを安全に管理する仕組み

- サーバーアーキテクチャ:複数のトレーニング処理を同時に実行できる計算環境(並列実行・再現性)

- エッジ推論システム:カメラやロボットとリアルタイムで連携しながら推論を実行する仕組み

- 運用設計:監視・ログ・ロールバックなどを含む運用フロー

こうした仕組みについては、Eureka Roboticsのバラ積みピッキング向けAIビジョンソフトウェアでも詳しく紹介しています。

ベンダー評価チェックリスト

「AIバラ積みピッキング」を比較する際は、次を確認すると実力差が見えます。

- 新規SKU追加時の学習手順(必要工数・所要時間)

- CADデータの要否、アノテーション済み画像の要否

- 立ち上げ時に必要な画像枚数の目安

- 類似部品への横展開のしやすさ

- 照明変動時の再学習要否

- 学習処理の実行場所(ローカル / クラウド)

- モデル更新の運用(検証・ロールバック・停止時間)

まとめ:導入判断は「初期精度 × 改善速度」

バラ積みピッキングにおけるMLの価値は、はじめに述べた通り、認識の頑健性と導入後改善を回せる運用性にあります。

導入判断では、初期の認識精度と、失敗を学習に取り込んで改善を回せる速度の両方が重要です。

量産現場での成否を左右するのは、モデル単体ではなく、データ・基盤・運用を含めた全体設計であり、ベンダー選定では本稿のチェックリストを参照すると実力差が見えます。

Eureka Roboticsは多数の実績を持つため、有力な選択肢の一つとして検討に値します。バラ積みピッキングをお考えの際は、ぜひご検討ください。